最近,有个所谓的“卢文庆录音”因为内容尺度大,引起了大家的注意。后来发现,这其实是AI伪造的。这下AI技术成了众矢之的,人们对它的使用和监管开始关注起来。这里面有很多值得我们认真思考和预防的问题。

AI伪造技术原理

AI伪造录音是“深度伪造”技术的一部分。这种技术利用深度学习算法,可以模仿人的声音和表情。只要有点素材,AI就能制作出非常逼真的假视频、假图像、假声音。比如,要伪造卢文庆的录音,只需要截取他直播时的音频片段,然后输入到Reecho睿声模型这样的工具里,几秒钟就能生成非常像他的AI声音,再调整一下情绪和语调,就搞定了。虽然现在合成的音频可能有点小瑕疵,但随着技术的进步,这些问题将来很可能得到解决。

在现实生活中,不少企业都在探索AI合成技术,比如风平智能这样的AI公司。他们发现现在的AI技术已经很成熟了,用几分钟的音频素材就能迅速制作出语音克隆,还能调整语气和情绪。这也解释了为什么虚假信息能这么容易地出现。

识别AI伪造的难点

识别AI伪造的音频是有技术方法的。比如,可以在音频中加入特定的噪声作为标记,通过检测这些标记就能判断出音频是否由AI合成。但在实际操作中会遇到不少难题。很多AI公司因为成本问题,不愿意在识别技术上投入资金。所以,即便有技术手段,也难以在广泛范围内得到应用。

不少小型的AI公司,资金并不宽裕,它们更愿意把资金用在研发新产品上以谋取利润,而不是音频识别技术。正因为如此,市面上很多AI合成的音频难以被发现,这也给那些想利用AI做违法勾当的人提供了机会。

AI伪造的危害实例

之前发生的那起诈骗案就是个典型的例子。犯罪分子用AI换脸和变声技术,冒充公司高层,通过视频会议让员工多次转账。这事儿暴露出AI技术门槛低、仿真度高,容易被坏人利用,安全隐患是相当的大。

生活中这类事儿可能会越来越常见,当咱们普通老百姓分辨不出视频和音频的真假时,一不小心就可能掉进骗子的圈套。特别是一些老年人,他们对AI这种新技术不太懂,往往容易被那些伪造的音频骗术给骗了。

AI正面应用的领域

尽管存在被伪造的风险,但AI的积极影响不容忽视。它在众多领域都扮演着关键角色。比如,在虚拟数字人和语音助手方面。众多大型的互联网企业都推出了自己的语音助手产品。这些助手能帮助用户迅速获取信息,大大提升了我们的生活效率。

不少科技公司都在搞虚拟数字人的开发,这玩意儿能用在娱乐、客服上,给大伙儿带来新鲜感。看这些用法的正面效果,咱们就能明白,只要用得得当,AI这技术就能提高生产效率,还能让娱乐体验变得更好。

AI技术监管的迫切性

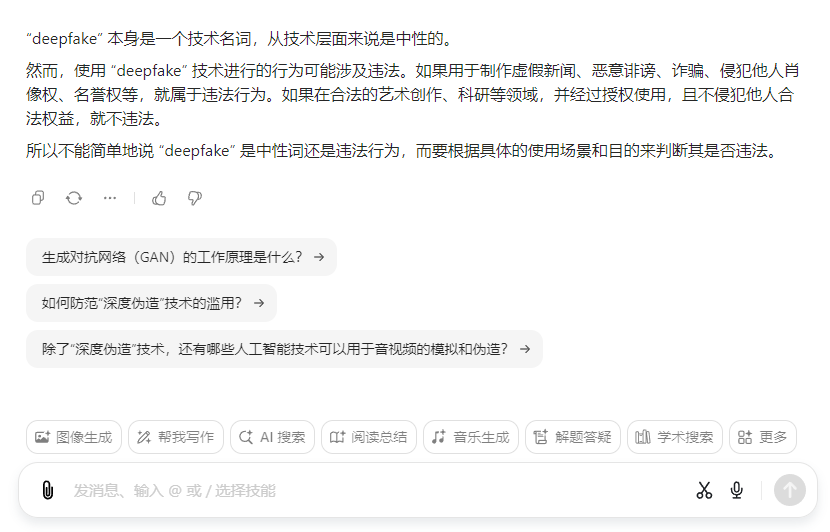

AI技术本身是中性的,没有好与坏的区别,但要是被不当使用,就会带来不好的结果。拿小杨哥事件来说,AI技术虽然很厉害,它的影响还是得看人是怎么用它。现在滥用AI技术的情况挺多的,所以得赶紧加强监管。这得包括制定法律和规定,还有技术上的监管办法。

政府部门得赶紧制定出针对AI伪造音视频的法规来,要是有了明确的法律条文,那些坏家伙就不敢随便用这招去骗人了。

未来发展与人性的关系

AI技术不断发展,将来与之相关的法律法规和识别技术也会逐步变得完善。然而,AI技术的最终走向还是掌握在人的手中。只有人们有了自我约束和监管的意识,才能确保AI向好的方向发展。无论是负责研发的开发人员,还是使用AI的普通用户,都应当具备防范AI被滥用的警觉性。

各位读者,你们觉得咱们在平时怎么才能快速能看出哪些内容是AI造的?欢迎各位在评论区留言,点个赞,把这篇文章转发出去。

内容来自网络,如有侵权,联系删除。

猜你喜欢

发表评论

电子邮件地址不会被公开。 必填项已用*标注