在数字化领域的深层次,一场科技和艺术相互融合的变革已悄然发生。今天,让我们共同探寻这个充满活力与挑战的领域——人工智能(AI)动画生成技术,它将从简略的文字叙述中创生出震撼人心的动态视觉效果。

文字之舞:AI如何读懂并展现文字

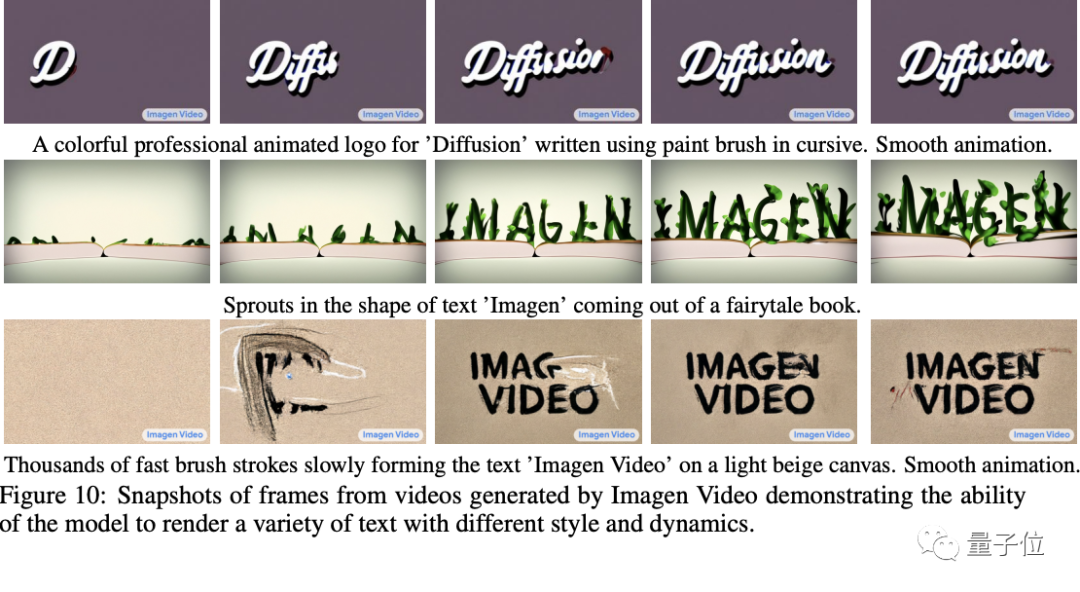

深度揭示AI如何理解和转化文字:利用Google自家研发的T5-XXL模型,这个多语种翻译大师能够精准地把人类语言化为计算机能理解的代码,经过训练后,文本编码器会被固定,以保证每次转换均一致准确。这不仅是技术的胜利,更是对于语言理解更深层次的研究突破。

随后,本模型将文本特性转移至后继的视频扩散模型,承担起文本至图像的转化过程。其设计理念与传统的CLIP模型存在明显差异,后者倾向于直接实现文本至图像的对应映射关系。在此过程中,语言模型仅担任编码角色,如何构建丰富的图像则由更具专长的视频扩散模型来完成。如此设计极大地提升了处理效率,且所生成的图像更为生动多彩。

帧与帧的艺术:视频生成的秘密

视频生成犹如芭蕾舞精心编排,每个画面皆为舞者之姿态。基础模型将原始图像生成48×24,每秒3帧的视频,之后采用自回归法持续预估下一帧,保证视频连贯性与流畅度。多种优化策略的融合,实现了高质量视频的呈现,每一帧图像均如镜面照人,展现出科技与艺术的完美结合。

风格与场景的变换:Phenaki的多面魅力

引入Phenaki模型,犹如为舞蹈赋予新的装束与舞台。它不仅可生成高清晰度视频,还可在卡通风格间自如转换,并随需切入各种场景设定。这种智能化的控制使得视频制作过程更为灵动且富于想象力。

故事的力量:Phenaki的叙事能力

然而,Phenaki真正引人注目的特点在于其讲述故事的高超技艺。仅依据多达200个字符的一系列线索,便可生成持续至少两分钟且情节连贯的精彩视频。这不仅是科技上的重大突破,更深刻测试了AI对人类文化与情感的洞察。

时间的编织者:因果模型的应用

作为前端技术,视频生成使用的因果分析模型来自于Transformer框架。此模型将视频视为图片的连续排列,依照时间顺序对其进行因果分析与重建。这一创新方式使视频产生更为高效且故事阐述更为自然流畅、扣人心弦。

训练的艺术:Phenaki的成长之路

Phenaki的培训方法宛如艺术家打磨艺术技巧。其主要采用文本-图像数据训练,辅以短视频文本训练,从而打破传统视频数据集的局限性,进一步提升创造力。

未来的展望:AI与艺术的融合

展望未来,AI视频生成技术将日益成熟,不仅作为工具发挥作用,更成为了艺术创新的伙伴。尽管业界可能对AI高度精细化操控有更多期待,然而无疑的是,AI已逐步融入我们的日常生活之中。

若您对此项科技充满好奇心,欢迎尝试清华和智源实验室研发的Cogvideo,亲身体验文字转为视频的神秘过程。

内容来自网络,如有侵权,联系删除。

猜你喜欢

发表评论

电子邮件地址不会被公开。 必填项已用*标注